Context Gateway aborda un problema recurrente en el uso productivo de agentes de inteligencia artificial como Claude Code o Cursor: las sesiones largas de debugging pueden acumular historiales extensos, donde una secuencia de 178 mensajes puede acumular fácilmente 89.000 tokens, presionando los límites de ventanas de contexto de modelos como Claude de Anthropic que van desde 128K hasta 1M tokens según el modelo. Tradicionalmente, la solución pasaba por reiniciar sesiones, ejecutar comandos manuales de compactación o asumir pérdida de contexto, lo que degradaba la experiencia de usuario y encarecía la operación. Context Gateway, proyecto open source de Compresr AI, propone resolver este cuello de botella mediante compresión automática, transparente y en segundo plano del contexto de los agentes.

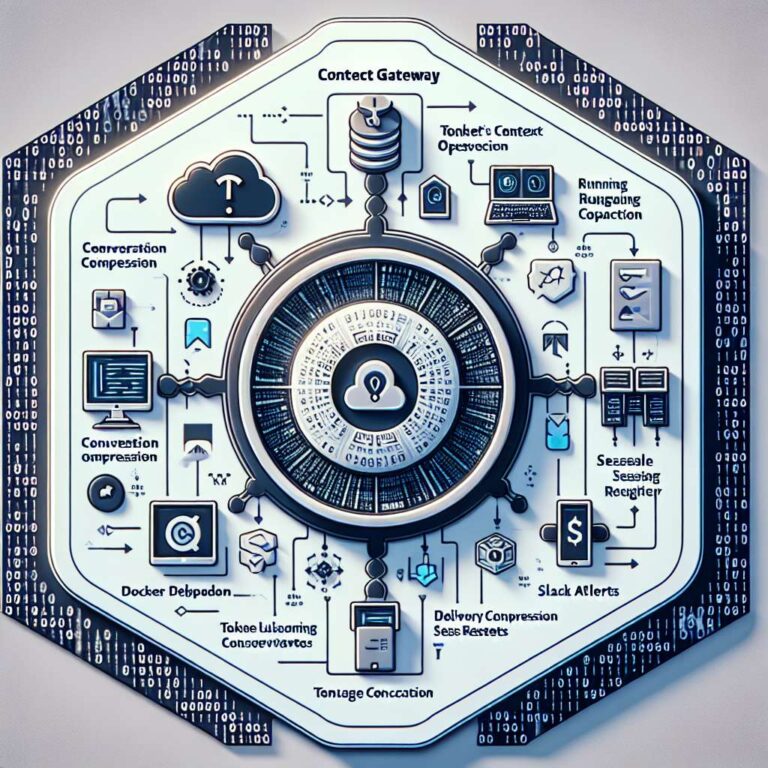

El sistema funciona como un proxy local que se interpone entre el agente de inteligencia artificial y la API del modelo de lenguaje, interceptando cada request antes de que llegue al LLM. Cuando la utilización del contexto supera un umbral configurable, por defecto 75% de utilización de la ventana de contexto, el proxy activa un modelo de compresión que clasifica qué fragmentos del historial y outputs de herramientas son prescindibles según el request actual y los descarta sin reescribir texto, evitando generar nuevos tokens. La arquitectura se organiza en tres pasos: intercepción de la request del agente, evaluación del nivel de ocupación del contexto para aplicar compresión selectiva condicionada al request, y un envío transparente del contexto comprimido al LLM, devolviendo la respuesta al agente sin interrumpir el flujo de trabajo. El ratio de compresión actual es de 0.5x, reduciendo el contexto a la mitad, con una hoja de ruta hacia ajustes automáticos por tipo de contenido como campos JSON atómicos, logs verbosos u outputs de herramientas.

La propuesta se diferencia de enfoques basados en resúmenes porque prioriza la poda estructurada de tokens irrelevantes para preservar contexto crítico, especialmente en tareas de codificación. Investigaciones independientes de Factory.ai sobre compresión de contexto en agentes de inteligencia artificial, basadas en conjuntos de datos con más de 36.000 mensajes reales, indican que métodos estructurados de compresión preservan más del 80% de la continuidad de tarea en comparación con la truncación simple. Para su adopción en equipos, Context Gateway ofrece despliegue local vía Docker en menos de un minuto, dashboard de uso de tokens y ahorro, límites de gasto con alertas vía Slack, compatibilidad con agentes como Claude Code, Cursor, OpenClaw y Codex, y código del proxy en open source, mientras que el modelo de compresión propietario es gratuito durante el lanzamiento. Frente a alternativas como Kong AI Gateway, la compactación nativa manual de Claude Code, frameworks de evaluación de Factory.ai o gateways orientados a interoperabilidad como Model Context Protocol, la ventaja radica en su especialización en flujos de trabajo de codificación y en su enfoque de compresión condicionada al request. En escenarios reales como debugging de sesiones largas, trabajo sobre grandes codebases y control de costos con modelos que cobran entre $3 y $15 por millón de tokens, comprimir el contexto a la mitad puede traducirse en ahorros operativos inmediatos manteniendo la continuidad de las sesiones.